Dank einer erneuten Projektförderung der Landeshauptstadt Dresden können wir nun die ersten zwei Szenen von VIRTUAL CHOIR realisieren. Außerdem wollen wir einen öffentlichen Hackathon im Hole Of Fame veranstalten, dass ursprünglich für Februar geplant war. Wir hoffen, dass es bald eine Öffnungsperspektive für Kulturorte geben wird und wir das Hackathon zu einem späteren Zeitpunkt nachholen können.

Online-Teamtreffen

Tom Micklich übernimmt weiterhin die technische Leitung und arbeitet von Leipzig aus, Christoph Groß erarbeitet die OSC-Schnittstellen und hat das Kinect-Bewegungsskript für Unity3D entwickelt. Er und Katharina Groß, die das Sounddesign erarbeitet arbeiten von Dresden aus. Von Erfurt aus entwickelt Vitali Drazdovich zusammen mit Artem Dyadichkin aus Berlin derzeit an der FFT-Analyse für die Szene „Feld“. Somit entwickeln wir die VR-Umgebung von vier Standorten in Ostdeutschland aus.

Ein erstes Team-Treffen via Skype hatten wir schon am 17. Februar. Unser nächstes Treffen steht für den 8. März an.

Die Idee

Aus bisherigen VR-Projekten wissen wir, dass zur Schaffung eines inklusiven Raumgefühls weder der hartkantige Realismus der meisten 3D-Computergrafiken oder eine lebendige, surreale Bildqualität noch die räumliche Abgrenzungen durch ein vertrautes, kartesisches Koordinatensystem notwendig sind. Stattdessen favorisieren wir eine visuelle Ästhetik, die semi-gegenständlich/ semi-abstrakt und aus halbtransparenten Texturen und fließenden Partikeln besteht. Diese Darstellungsweise – sowie auch die leiblich- durchdrungene Navigation durch den Raum – dient eher der „Evozierung“ eines verkörperten Lebens als der Illustration und Simulation. Bildwelten, die metaphorisch an Natur erinnern, erscheinen, zergehen und bewegen sich mit der virtuellen und leiblichen Bewegung: eine Lichtung mit See, ein Wald, ein Feld, eine steinige Wüste, unterirdische Höhlen, Berge und Täler, deren Soundtexturen durch Körperbewegung ausgelöst und modifiziert werden bzw. abstrakte Formen, die einzelne Klangobjekte darstellen und durch Körperbewegung zu Melodien und Rhythmen führen.

Die zugrunde liegenden digitalen Sound-Strukturen und Klangobjekte werden in der Entwicklerumgebung SonicPi programmiert. Wir werden elektrische Frequenzen modulieren, Klangfarben programmieren bzw. eigens aufgenommener Field Recordings nutzen, um die jeweiligen landschaftlichen Szenerien in der VR zu betonen. Jedes der Sound-Elemente hat seine spezifischen Filter, die durch Körperbewegung zu Modulationen dessen führen bzw. visuelle Effekte in der virtuellen Umgebung auslösen via OSC (Open Sound Control).

Die gleiche Bewegung soll niemals den gleichen Effekt haben, d.h. die Art, wie die Körperbewegungen mit der flexiblen Wahrnehmungsarchitektur übersetzt werden, ist nicht linear. Die Relation zwischen Akteur*innen und der Klanglandschaft darf weder komplett zufällig wirken, noch absolut kontrollierbar sein und soll dennoch stets ein Gefühl der Zugehörigkeit erzeugen. Es geht darum, ob die Akteur*innen ihren Augen und Interaktionen mit der Welt trauen; Vertrauen in die eigenen Interaktionen und Welterfahrung haben.

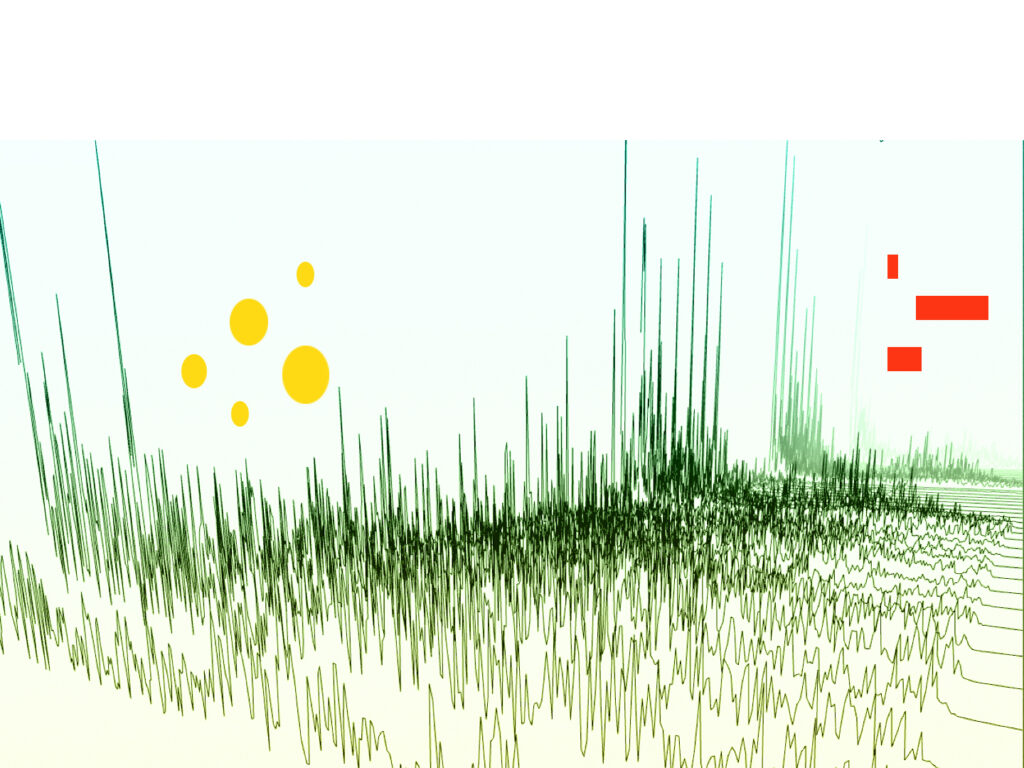

Szene FELD

Das “Feld” bildet eine oszillographische Abbildung des aktuellen Sounds, der durch Körperbewegung generiert wird. Zusätzlich erscheinen, schweben und zergehen geometrische Körper (Klangobjekte), die durch “Berührung” angesteuert werden können und dadurch Klänge mit kosmischen Frequenzen generieren ähnlich der Tastatur auf einem Klavier. Die ausgelösten Klänge werden gespeichert und als sich stets erweiternde Melodie abgespielt.

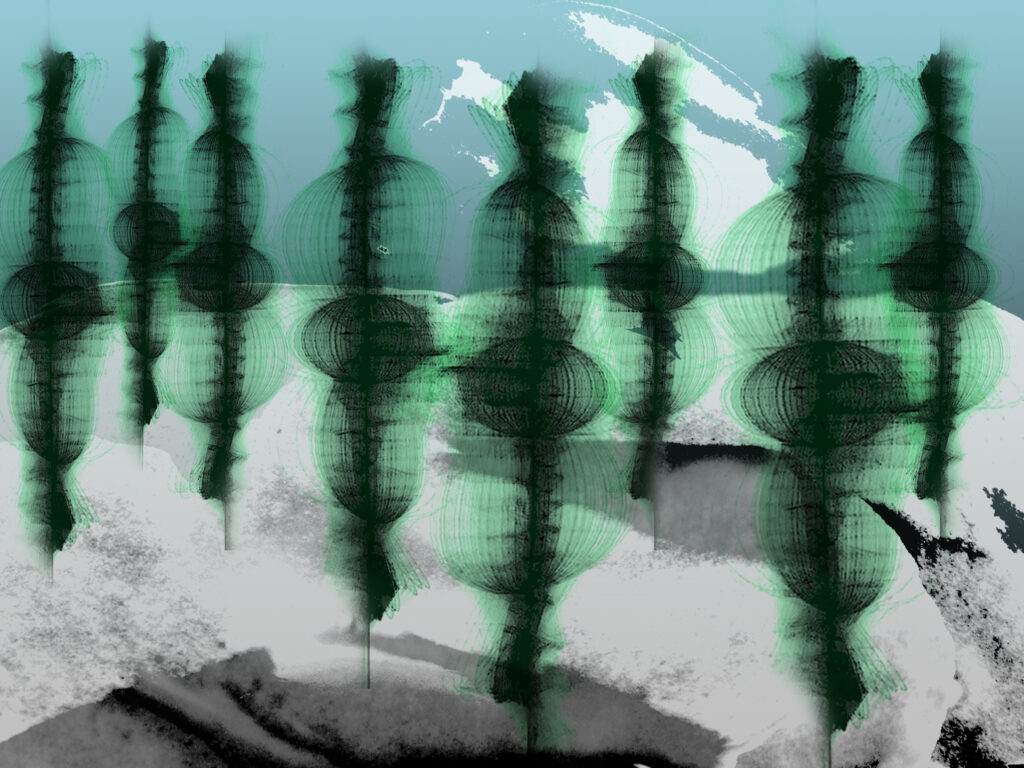

Szene WALD

Die “Bäume” des Waldes sind generierte Lissajour-Figuren, die sich durch Spracheingabe generieren und im Backend gespeichert werden. Um so mehr Akteur*innen ihre Stimme hinterlassen, desto größer wächst der Wald. Die Lautstärke der Sprachaufnahmen- Wiedergabe ist in Abhängigkeit zum Standpunkt des*der Akteur*in. Zusätzlich wird durch Körperbewegung die Soundtextur “Blätterrauschen” (Field-Recording) modifiziert sowie weitere synthetische Soundtexturen generiert. Tuschezeichnungen ergeben den Waldboden.